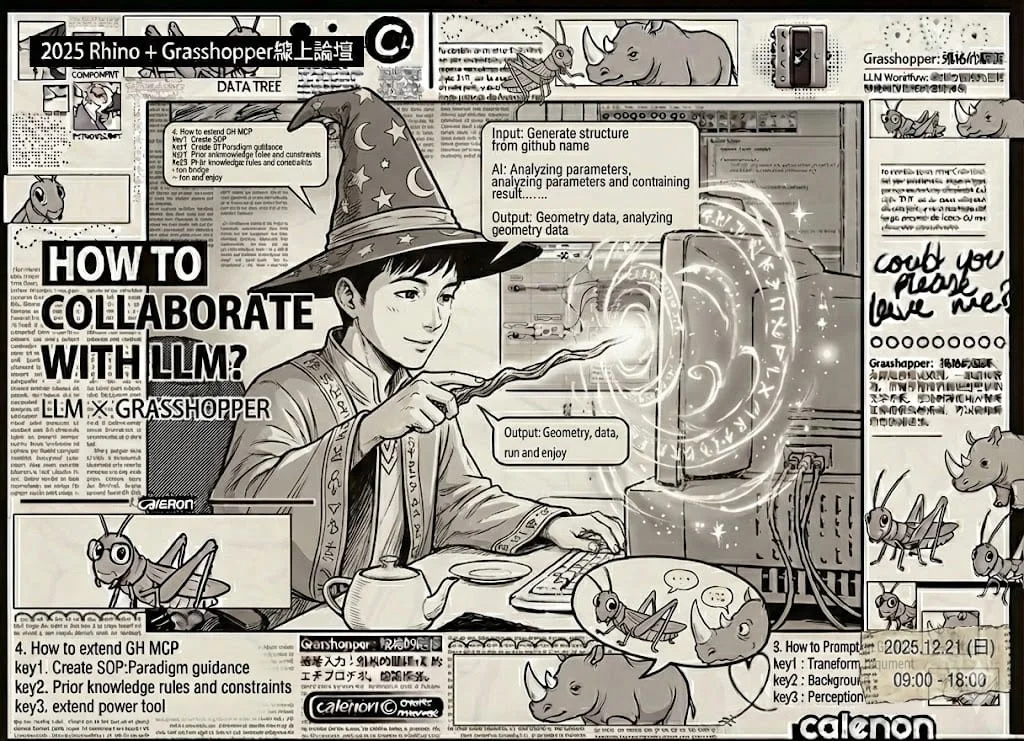

本次分享的主題是「如何與大語言模型(LLM)協作?」。參數化設計正在經歷一場變革,我們將聚焦在 LLM 與 Grasshopper 的整合。

課程大綱

分享分為四個核心部分:

- 驅動現況與策略規劃

- 系統開發架構

- LLM 的安裝與實作

- 人類角色的重新定位

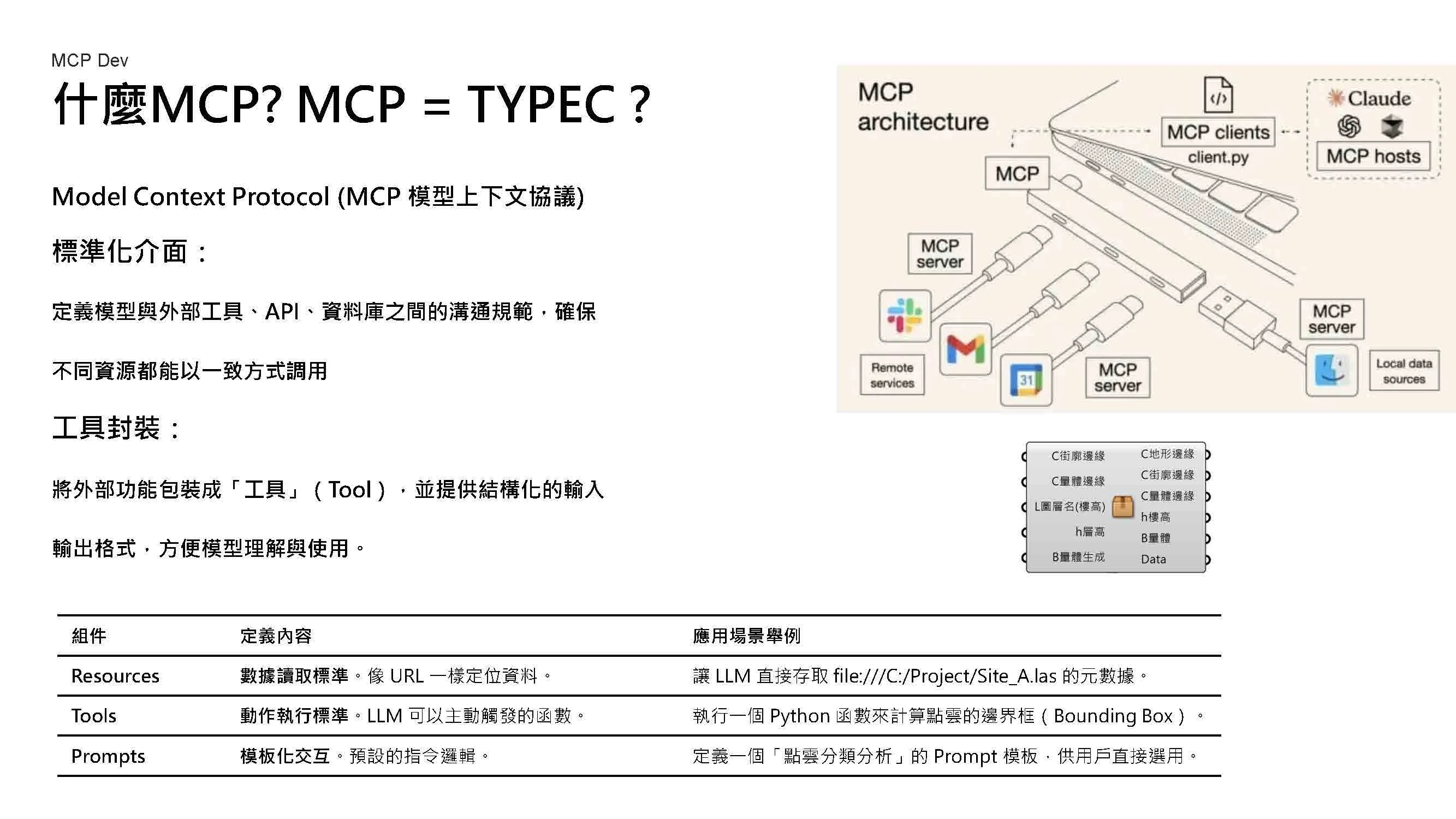

什麼是 MCP (Model Context Protocol)?

Model Context Protocol (MCP) 是模型上下文協議。它並非實體的硬體接頭,而是一種標準化介面,定義了 LLM 與外部工具、API 或資料庫之間的溝通規範。

透過 MCP,我們可以實現三大核心組件:

- Resources:讓 LLM 直接存取資料夾。

- Tools:執行特定的計算函數。

- Prompts:引導模型生成規範的結果。

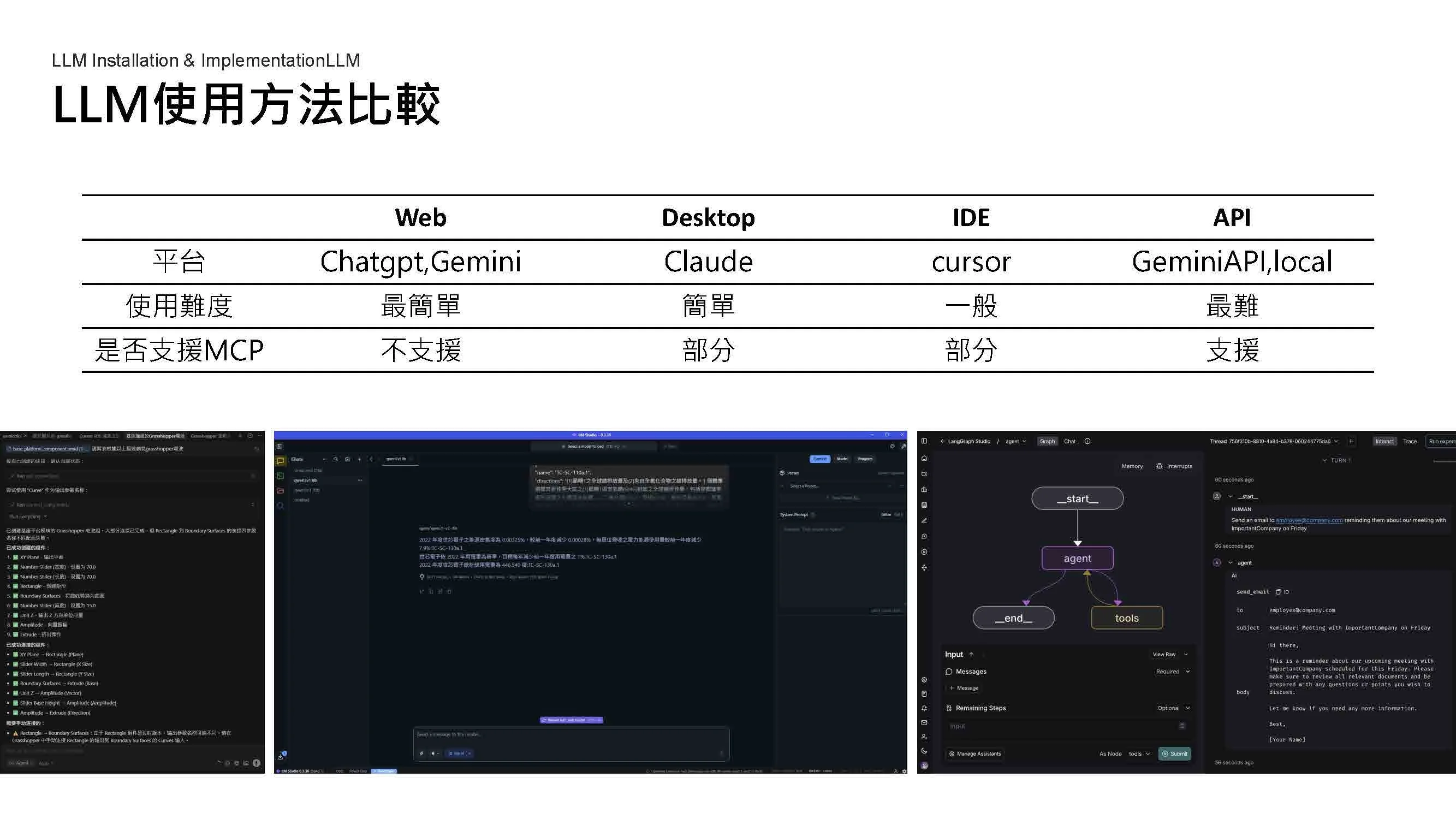

LLM 平台比較

在選擇 LLM 平台時,API 雖然使用難度最高,但對 MCP 的支援最為完整,這也是我們開發高階自動化流程的首選方式。

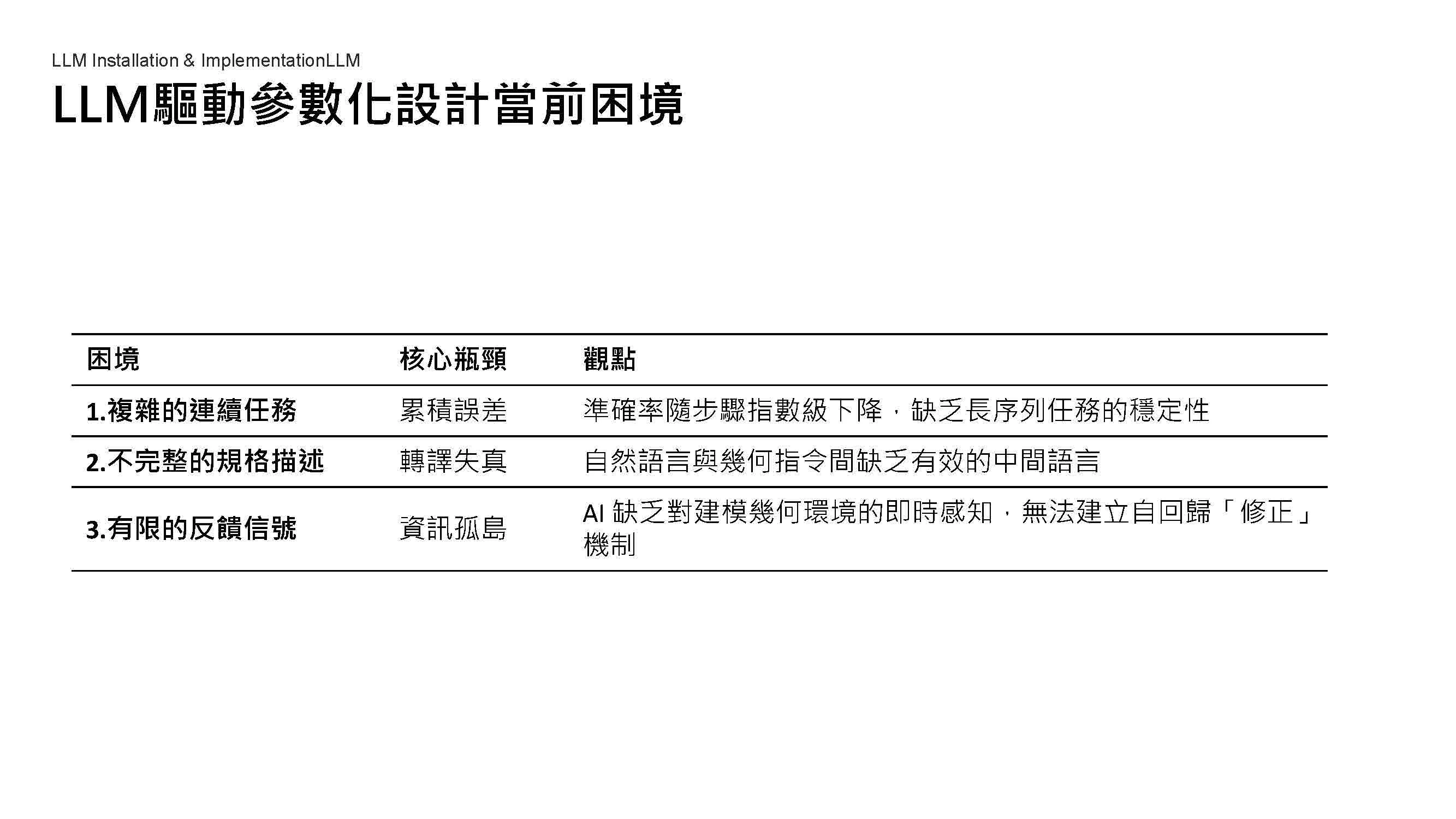

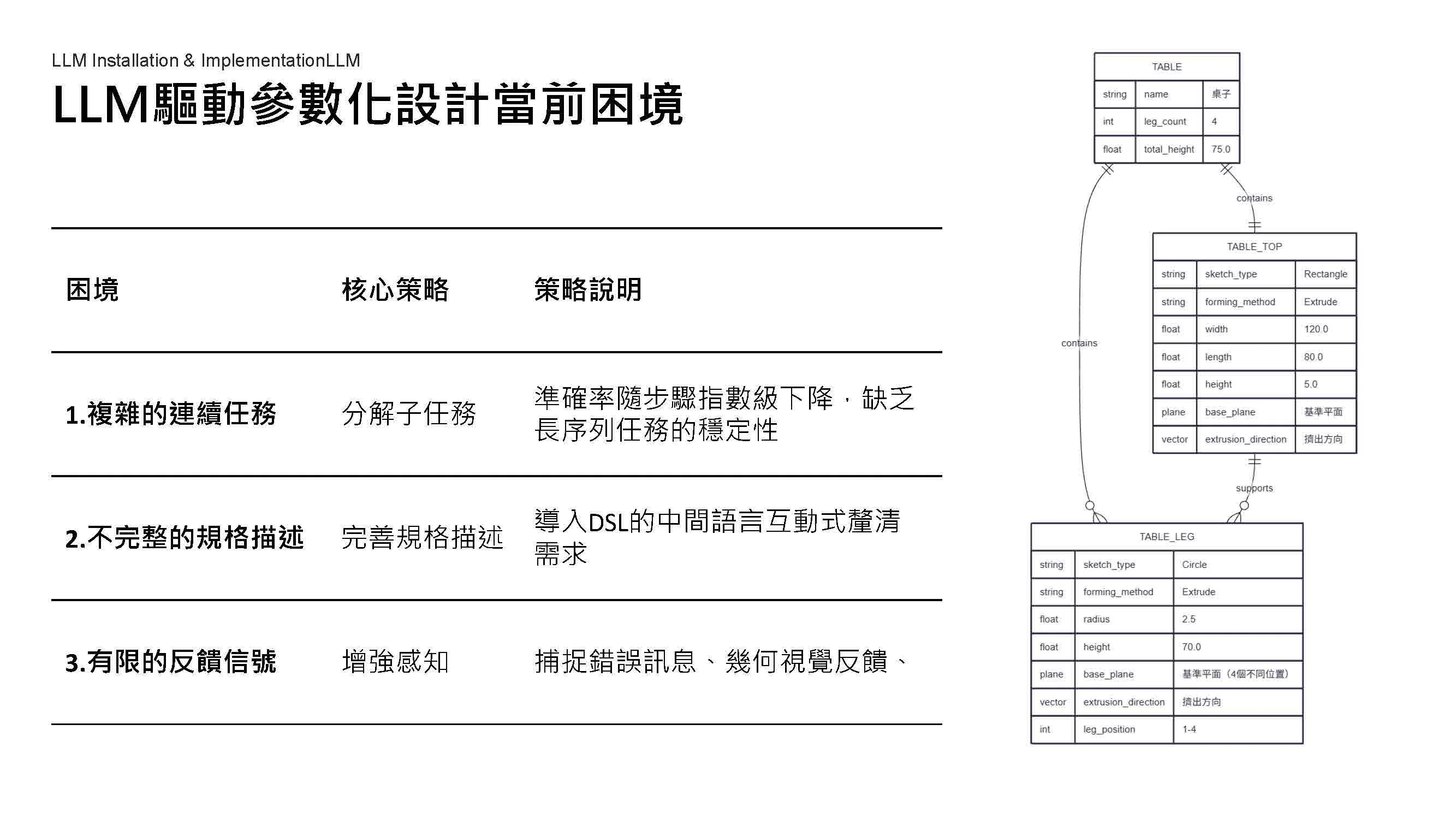

設計困境與策略規劃

目前 LLM 在參數化設計中面臨三大關鍵挑戰:

- 累積誤差:複雜任務在多步驟處理中容易產生偏差。

- 轉譯失真:不完整的規格描述導致設計意圖被誤解。

- 資訊孤島:有限的反饋信號讓 AI 無法自我修正。

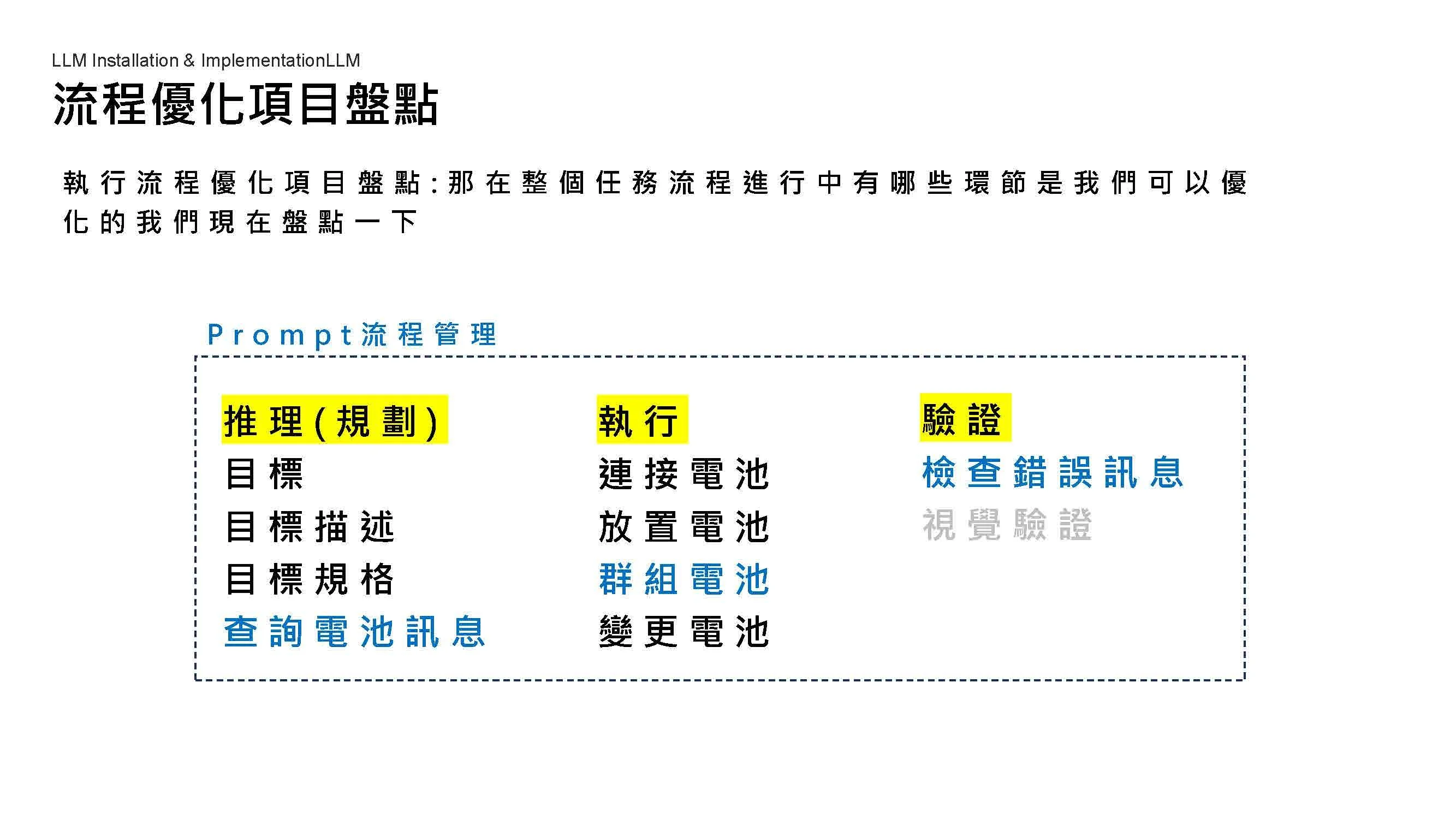

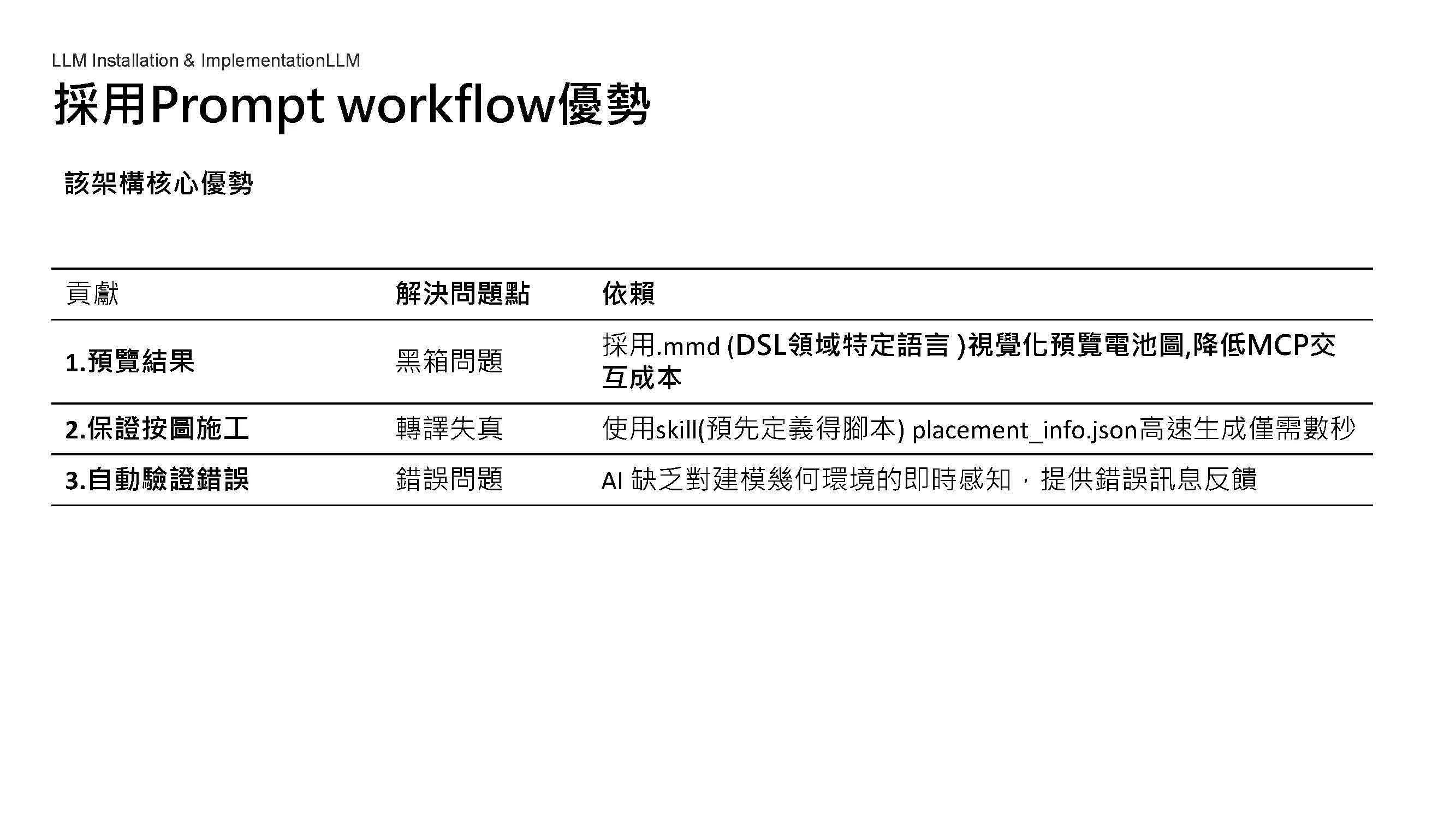

我們的核心策略是將任務分解、導入 DSL (領域特定語言) 作為中間語言,並增強 AI 對幾何視覺與錯誤訊息的感知。

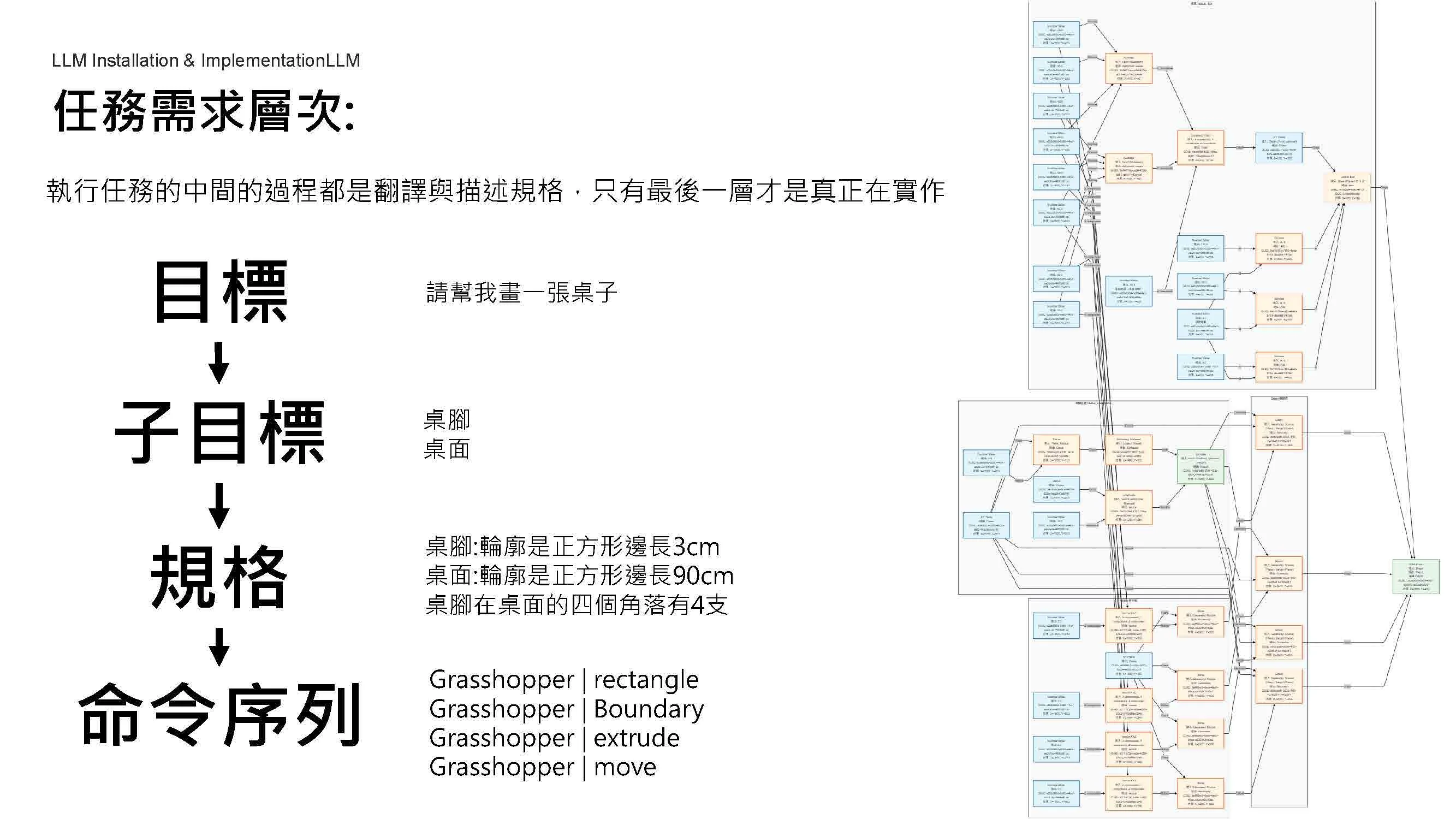

任務需求層次

實作任務時,中間過程多是在翻譯與描述規格。以「畫一張桌子」為例,需要從目標拆解成桌腳、桌面的規格,最後才轉譯為 Grasshopper 的命令序列。

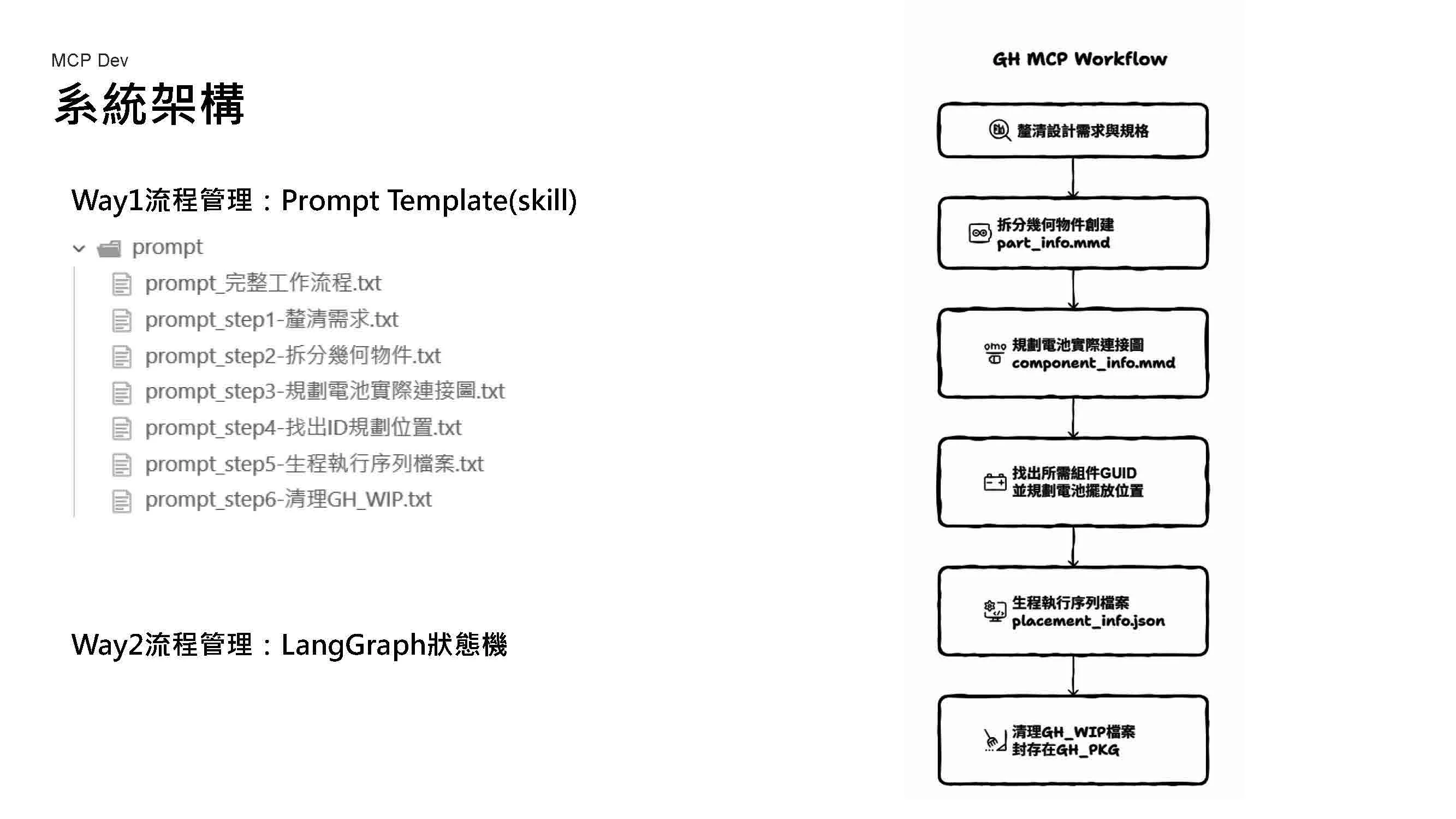

系統開發架構:GH MCP Workflow

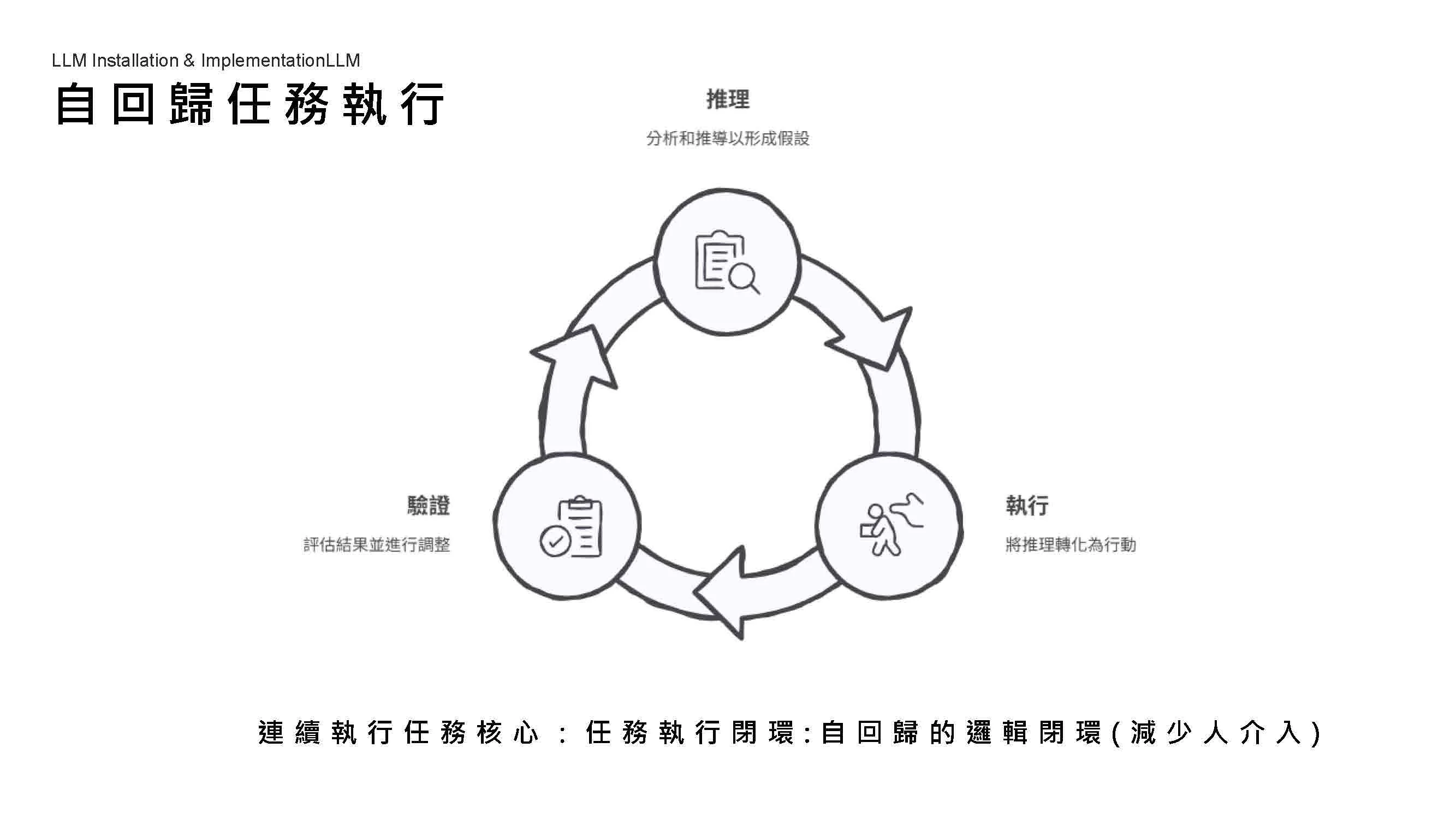

我們的系統架構包含六大步驟:從釐清需求、拆分物件、規劃連接圖、找出 GUID、生成序列檔案,到最後的清理。核心在於建立一個**「推理、執行、驗證」**的自回歸邏輯閉環。

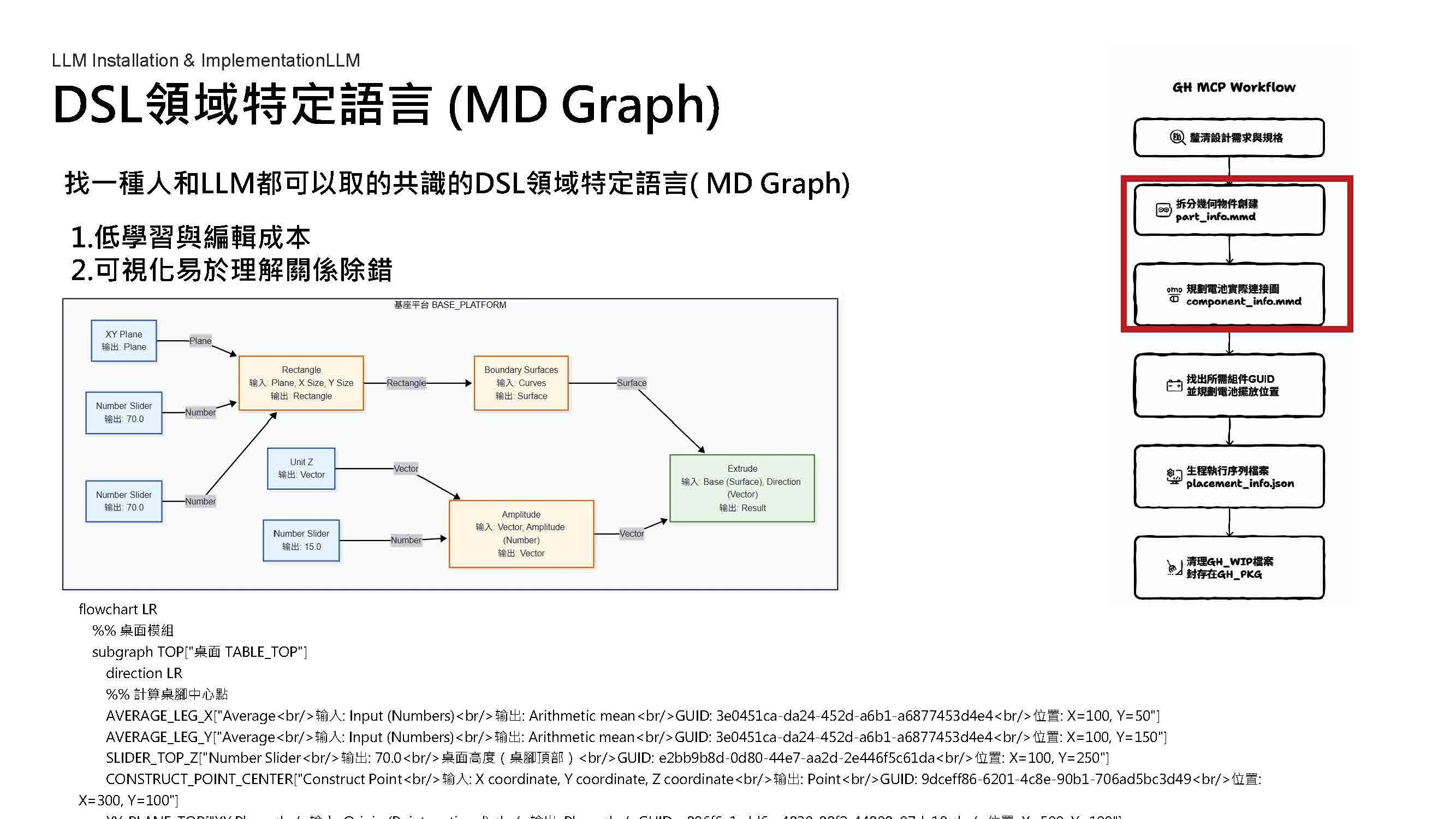

DSL 語言應用:Mermaid

我們採用 Mermaid (MD Graph) 作為人和 LLM 的共識語言。它的優勢在於:

- 低學習成本。

- 視覺化預覽。

- 自動驗證錯誤:能有效保證 AI 「按圖施工」。

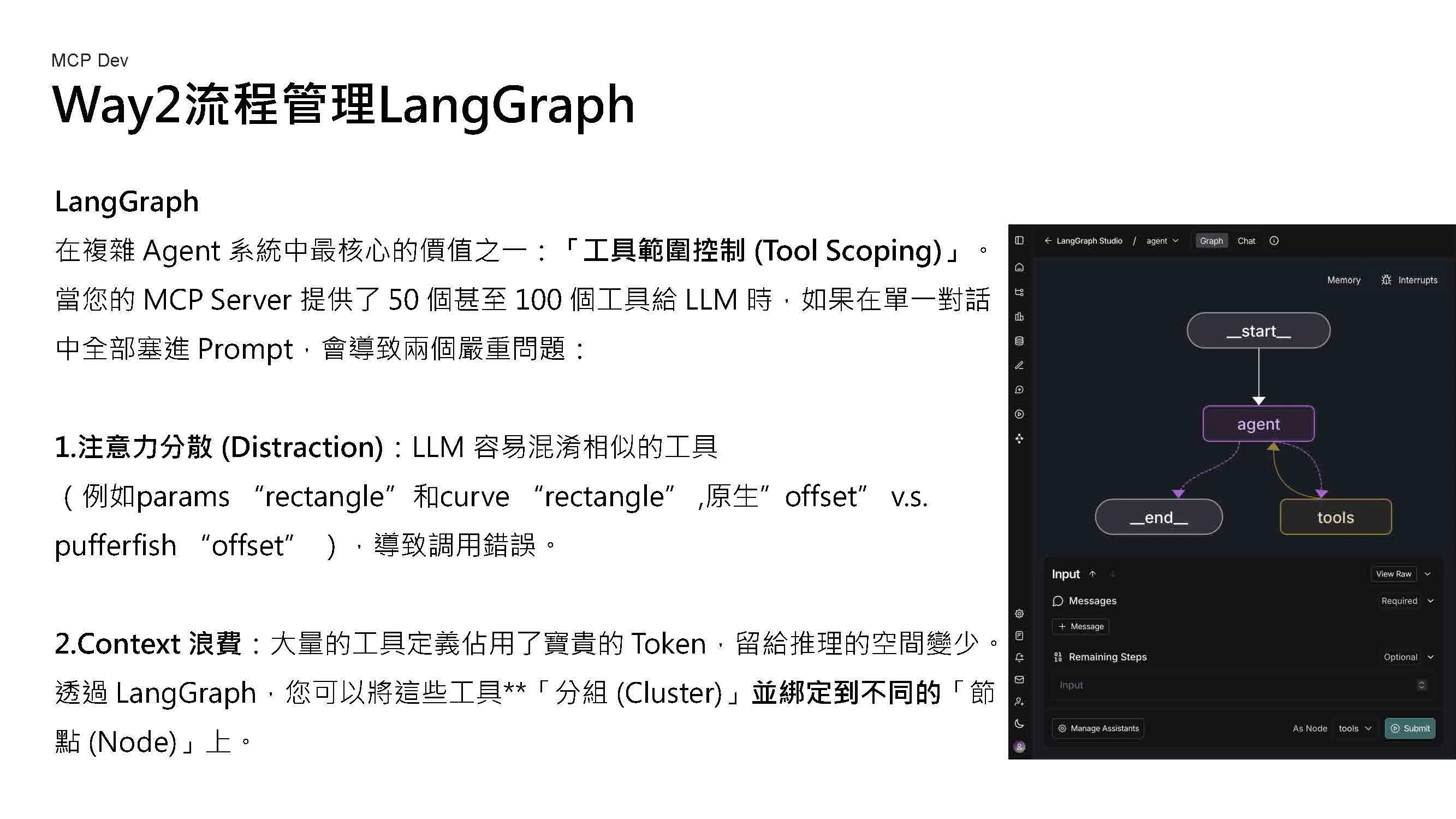

LangGraph 工具範圍控制

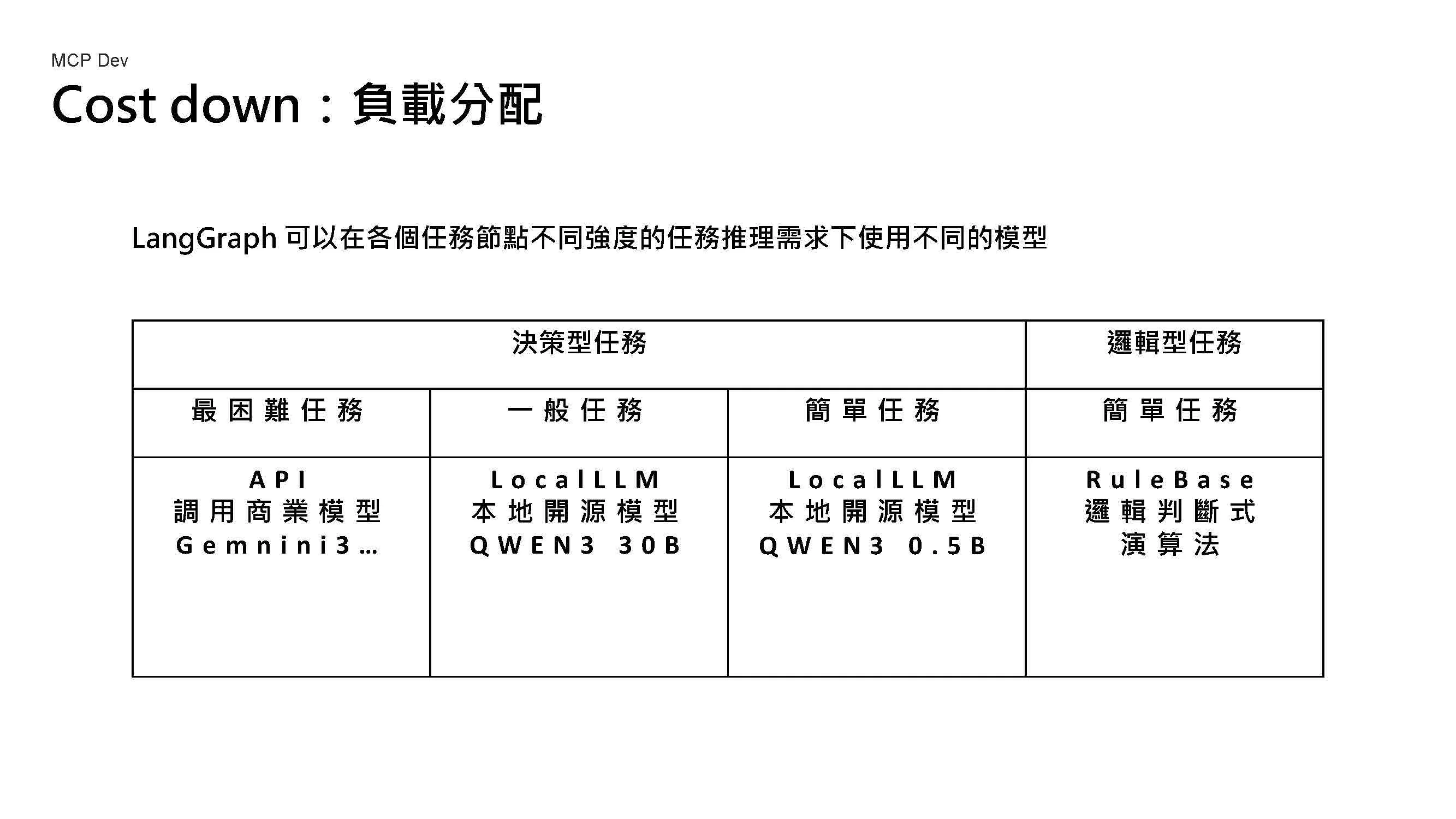

透過 LangGraph,我們可以實現「工具範圍控制」。當 MCP Server 提供上百個工具時,分組綁定到不同節點能避免 LLM 注意力分散,並能根據任務難度切換不同強度的模型來降低成本。

Thanks for reading!